Integrating AI Segmentation, Simulated Digital Twins, and Extended Reality into Medical Education: A Narrative Technical Review and Proof-of-Concept Case Study. Journal of Personalized Medicine, 16(4), 202.

https://doi.org/10.3390/jpm16040202画像データからデジタルツインへ

医用画像は長い間、断面の2次元表示に限定されてきました。CTやMRIは非常に詳細なデータを提供しますが、その解釈には経験と時間、そして外科医による空間的再構築が必要です。近年のAIの進歩はこのプロセスを根本的に変えています。

AIセグメンテーションは、画像データの準備に必要な時間を大幅に短縮します。これまで多大な手動処理を必要としていた作業は、現在では自動的に生成できます。臓器、血管、関心領域などの解剖構造は、CTやMRIデータから数秒で直接識別・分離され、手動作業なしで構造化された利用可能なデータが作成されます。

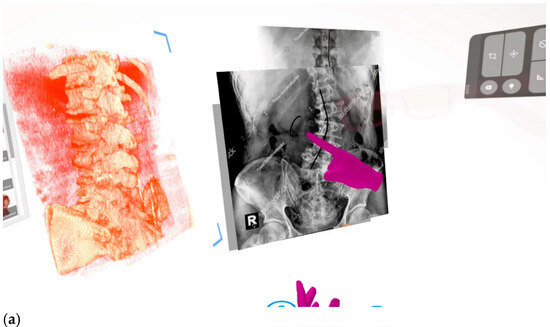

録画されたレッスンの一例で、学習者が講師の視界内に立ち、3Dレンダリングされた脊柱側弯モデルとX線画像の解剖図を並べて見ています。画像内のマゼンタ色の手は、レッスン再生中にデジタルコンテンツ上で描画している講師を示しています。

これらのセグメント化されたデータセットは、実際の解剖を表す患者固有の3Dモデルであるデジタルツインの基盤となります。個々の断面を解釈する代わりに、医療従事者や学生は空間内で完全な解剖構造と対話でき、空間理解を向上させ、認知負荷を軽減します。

AIセグメンテーションによってモデル作成が自動化されることで、デジタルツインの生成はスケーラブルになり、教育プログラムや機関全体での普及が可能になります。

理解とコミュニケーションの向上

デジタルツインは医療データの使用と共有方法を根本的に変えます。複雑な解剖学的関係が直接可視化され、病変は完全な空間的文脈の中で分離・探索できます。

所見を口頭で説明したり2D表現に依存する代わりに、臨床医や学生は共有された没入型環境で同じデータセットを一緒に確認できます。複数のユーザーがそれぞれの視点からリアルタイムでモデルにアクセスし操作できるため、分野横断的な連携と整合性が向上します。

四次元空間コンテンツの作成

このケースでは、講師はMedicalholodeckの RecordXR空間キャプチャツール を使用して、VR環境内でガイド付き教育セッションを記録しました。セッションには脊椎ランドマークの識別、神経軸アクセス技術、重度側弯症患者の病理学的解剖の3D注釈が含まれていました。

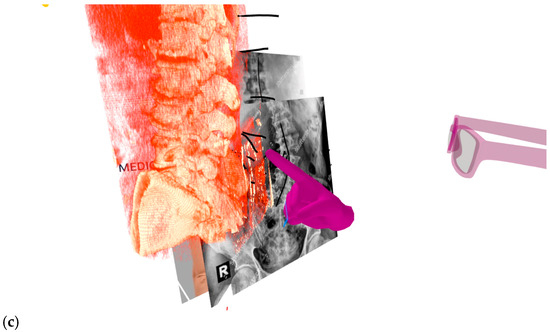

従来の2Dビデオ教材とは異なり、このXRベースのモジュールは解剖学的コンテキスト内で空間的理解と専門的な指導を保持します。講師の説明やジェスチャー、操作は3Dデータと結び付けられ、より直感的で没入感のある学習体験を提供します。

学習者はいつでもセッションを見直したり、特定の手順を再生したり、自らモデルと対話して理解を深めることができます。VRでの記録により、教育者はアクセス可能で再利用可能かつスケーラブルな症例・シミュレーション・教材の体系的なライブラリを構築できます。

このアプローチは視覚情報だけでなく専門家の思考過程も保持し、複雑な手技知識を再現可能で広く利用可能にします。

学習者が撮影時の講師の視点を超えて、さまざまな角度からRXRレッスンを観察できることを示しています。マゼンタ色のメガネと手は、学習者に可視化された講師の存在を表しています。講師は脊柱側弯モデル上で棘突起の傾きを示し、病的解剖の理解を深めています。

教育から臨床応用へ

教育分野を超えて、同様のワークフローは臨床現場にも直接応用できます。AIセグメンテーション、デジタルツイン、記録、XRの組み合わせにより、術前計画、学際的連携、患者特異的シミュレーションが統合された環境で実現されます。

学習と臨床応用の連続性により複雑さが軽減され、より情報に基づいた意思決定が可能となり、トレーニングと実際の医療とのギャップが埋められます。

空間的医療教育への転換

医用画像を構造化された3Dデータに変換し、それを動的なデジタルツインへと発展させることで、AIは没入型で個別化され、臨床実践に直接結びついた新しい学習形態を可能にします。

XRと組み合わせることで、このアプローチは教育を空間的でインタラクティブな体験へと変革し、次世代の臨床医をデータ駆動型かつシミュレーション中心の未来に備えさせます。